publicado por Hoi Lam Aprendizaje automático de Android

Esta publicación de blog es parte de una serie semanal # 11WeeksOfAndroid. Cada semana nos sumergimos en un área clave de Android para que no te pierdas nada. Durante esta semana, cubrimos varios aspectos del aprendizaje automático en dispositivos Android (ML). Cualquiera sea la fase de desarrollo, ya sea una aplicación inicial o consolidada; cualquiera que sea el papel que juegue en diseño, producto e ingeniería; Sea cual sea su nivel de habilidad, desde principiante hasta experto, tenemos una amplia gama de herramientas de ML para usted.

Diseño – ML como diferenciador

"Centrarse en el usuario y todo lo demás seguirá" es un mantra de Google que se vuelve aún más relevante en nuestra era de aprendizaje automático. Nuestro abogado de diseño, Di Dang, enfatizó la importancia de encontrar la intersección única entre los problemas del usuario y las fortalezas de ML. Con demasiada frecuencia, los equipos están tan entusiasmados con la idea del aprendizaje automático que pierden de vista las necesidades de sus usuarios.

Di describió cómo la Guía People + AI puede ayudarlo a tomar decisiones sobre los productos de ML y usó el ejemplo de la aplicación Read Together para ilustrar temas como la precisión y el atractivo, que son únicos en diseño y Desarrollo de ML. Eche un vistazo a su entrevista con el equipo Lea junto con su equipo para obtener más inspiración.

Nuevo kit ML totalmente centrado en el dispositivo

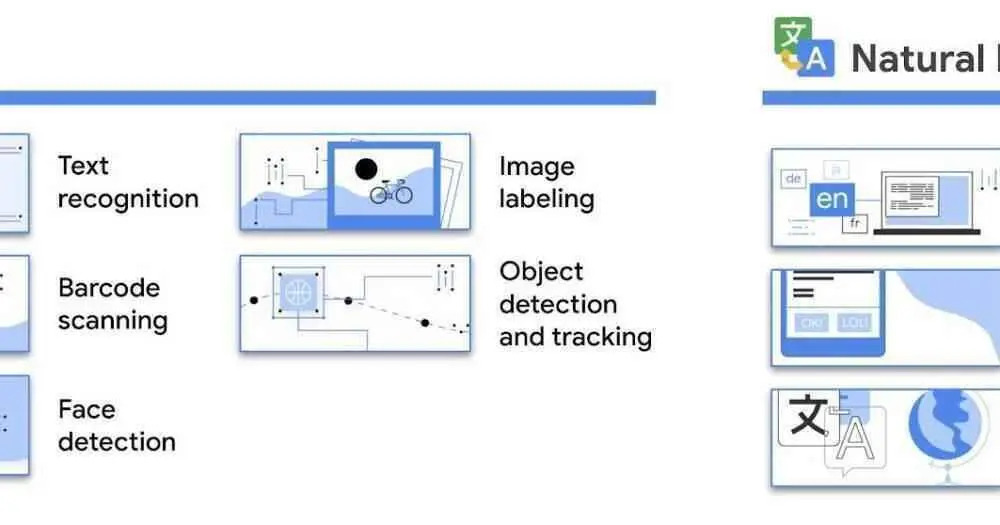

Cuando decida que el aprendizaje automático en el dispositivo es la solución, la forma más fácil de implementarlo será a través de un SDK llave en mano como ML Kit. Modelos sofisticados formados por Google y las canalizaciones de procesamiento se ofrecen a través de una interfaz fácil de usar en Kotlin / Java. ML Kit está diseñado y construido para ML en el dispositivo: funciona sin conexión, ofrece mayor privacidad, desbloquea alto rendimiento para casos de uso en tiempo real y es gratuito. Recientemente convertimos el ML Kit en un SDK independiente y ya no necesitamos una cuenta de Firebase. Solo una línea en el archivo build.gradle y puede comenzar a incorporar la funcionalidad ML en su aplicación.

El equipo también agregó nuevas características como el soporte del ciclo de vida de Jetpack y la opción de usar patrones de contorno de la cara a través de los servicios de Google Play al guardar hasta 20 MB en el tamaño de la aplicación. Otra adición muy esperada es el soporte para el intercambio de modelos de Google con los suyos, tanto para el etiquetado de imágenes como para la detección y seguimiento de objetos. ¡Esto proporciona una de las formas más fáciles de agregar modelos TensorFlow Lite a sus aplicaciones sin interactuar con ByteArray!

Personalizar con las herramientas TensorFlow Lite y Android

Si el modelo base proporcionado por ML Kit no se ajusta perfectamente, ¿qué deben hacer los desarrolladores? El primer puerto de escala debe ser el centro TensorFlow, donde puede descargar los modelos TensorFlow Lite listos para usar para Google y la comunidad en general. Desde 100,000 productos de supermercados de EE. UU. Hasta clasificadores de enfermedades de plantas de tomate, la elección es suya.

Además de Firebase AutoML Vision Edge, también puedes crear tu propio modelo usando TensorFlow Model Maker (clasificación de imágenes / clasificación de texto) con solo unas pocas líneas de Python. Una vez que tenga un modelo TensorFlow Lite de TensorFlow Hub o Model Maker, puede integrarlo fácilmente con su aplicación de Android usando ML Kit Image Labeling o Object Detection and Tracking. Si prefiere una solución de código abierto, Android Studio 4.1 beta presenta la asociación del modelo ML que le permite envolver el modelo TensorFlow Lite con un envoltorio Kotlin / Java fácil de usar. Agregar un modelo personalizado a su aplicación de Android nunca ha sido tan fácil. Echa un vistazo a este blog para más detalles.

Ahora es el momento para ML en el dispositivo

De los ejemplos de los ganadores del Android Developer Challenge, es obvio que el aprendizaje automático en el dispositivo ha crecido y las características de ML una vez reservadas para la nube o las supercomputadoras ahora están disponibles en su teléfono Android. Da un paso adelante con nosotros probando nuestros códigos del día:

También eche un vistazo a la ruta de aprendizaje de la semana de ML y realice la prueba para obtener su insignia personal de ML.

El aprendizaje automático en el dispositivo Android es una plataforma en rápida evolución, si tiene solicitudes de mejora o comentarios sobre cómo podría mejorarse, infórmenos junto con su caso de uso (kit TensorFlow Lite / ML) . El momento para ML en el dispositivo es ahora.

Recursos

Puede encontrar la lista de reproducción completa del contenido de video # 11WeeksOfAndroid aquí y obtener más información acerca de cada semana aquí. Continuaremos resaltando nuevas áreas cada semana, así que estén atentos y síganos en Twitter y YouTube. ¡Muchas gracias por permitirnos ser parte de esta experiencia con usted!

MiReal.me MiReal.me – Tu blog tecnológico con la más actualizada información

MiReal.me MiReal.me – Tu blog tecnológico con la más actualizada información